Pesquisadores especializados em tecnologia da informação, da computação ao jornalismo, defendem a criação de um órgão intergovernamental para acompanhar o desenvolvimento tecnológico. em um artigo publicado em Natureza, Sugerem que se trata de uma ameaça com características semelhantes às da crise climática e, por isso, reivindicam a criação de uma entidade semelhante ao Painel Intergovernamental sobre Mudanças Climáticas ou (IPCC) no qual especialistas de diferentes áreas como política, a engenharia ou a ética trabalham juntas para monitorar os sistemas globais de distribuição de informações de maneira coordenada. Isso incluiria serviços bancários on-line, mídias sociais, mecanismos de pesquisa (como o Google) e modelos de linguagem generativa como o ChatGPT.

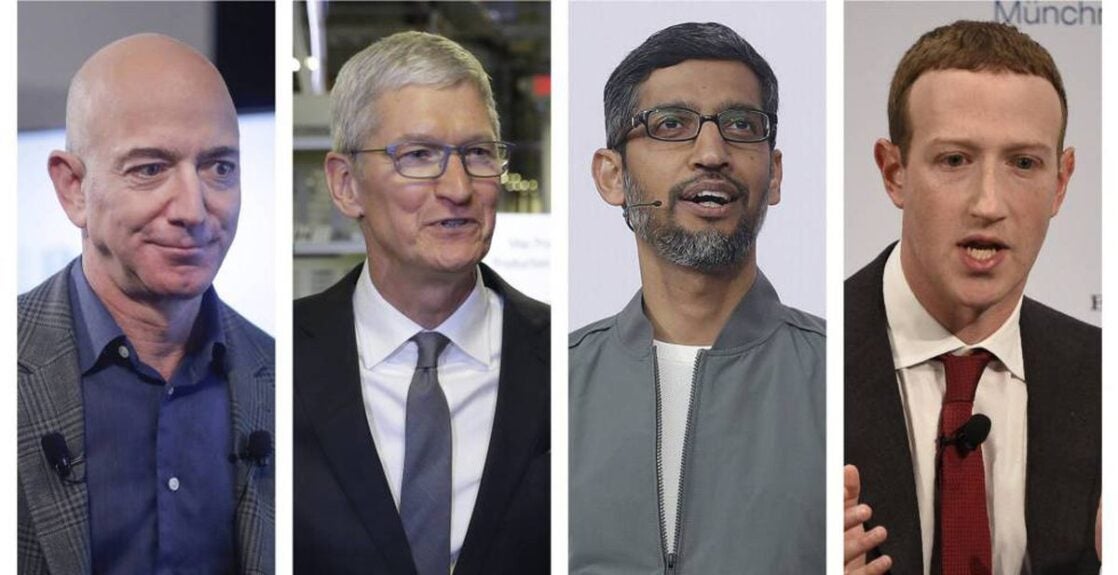

Eles não são os únicos que estão preocupados. Há menos de dois meses, Elon Musk, o cofundador da Apple Steve Wozniak e o historiador Yuval N. Harari assinaram, junto com milhares de especialistas, uma carta aberta para deter a corrida descontrolada da inteligência artificial (IA). Ontem, no Capitólio, Sam Altman, co-fundador da empresa que criou o ChatGPT, sentou-se pela primeira vez perante a Comissão Judiciária para pedir uma ação urgente e defendeu a criação de uma organização internacional que estabeleceria padrões para a inteligência artificial no estilo de como fez no passado com “armas nucleares”. Geoffrey Hinton, padrinho dessa tecnologia, deixou o Google e diz: “Se existe alguma forma de controlar a inteligência artificial, devemos descobri-la antes que seja tarde demais”.

No comentário postado em Natureza, os especialistas concordam que os riscos gerados pelas mudanças climáticas ou degradação ambiental têm a mesma complexidade, escala e importância que os apresentados pela gestão da informação em nível global, que está nas mãos de poucas empresas. Segundo eles, a tomada de decisão por meio de algoritmos pode exacerbar os preconceitos sociais existentes e dar origem a novas formas de desigualdade em diversos aspectos. No caso do acesso à habitação, citam que os algoritmos para orientar os proprietários de casas de aluguer, “têm suportado dinâmicas semelhantes às dos cartéis” no que diz respeito às restrições de oferta e preço. E os algoritmos que direcionam a polícia para áreas com potencial de alta criminalidade, usando dados de localização de prisões anteriores, “podem exacerbar os preconceitos existentes no sistema de justiça criminal”.

Em relação às redes sociais, consideram que a velocidade com que os conteúdos são criados e partilhados dá margem a mais desinformação e discurso de ódio. Enquanto isso, a IA generativa já está ameaçando as estruturas de emprego de setores inteiros e desafiando a percepção da sociedade com base no conhecimento científico. “O ChatGPT pode ameaçar a compreensão pública da ciência ao promover a produção de textos que contenham falsidades e irrelevâncias em escala industrial”, criticam. E acrescentam: “O mundo não está preparado cultural ou legalmente”.

Conhecimento e transparência

O objetivo desse grupo multidisciplinar que eles propõem não seria a busca de um consenso internacional ou desenvolvimento jurídico, mas sim fornecer “uma base de conhecimento que apoie as decisões de governos, grupos humanitários ou mesmo empresas” em escala global. “Assim como órgãos como o IPCC das Nações Unidas conduzem avaliações baseadas em políticas de mudança ambiental global, um grupo semelhante é agora necessário para entender e abordar o impacto das novas tecnologias de informação em sistemas de informação. mundo social, econômico, político e natural”, eles escrevem na nota, que foi assinada por Joe Bak-Colemanpesquisador de Centro Craig Newmark para Jornalismo, Ética e Segurança da Universidade de Columbia e Carl T. Bergstromprofessor de biologia da Universidade de Washington, entre outros especialistas.

Tal grupo, dizem eles, teria mais influência do que pesquisadores independentes ou organizações sem fins lucrativos para convencer a Big Tech a ser mais transparente. Na opinião deles, essas empresas estão “desenvolvendo uma série de táticas” para influenciar a percepção social de suas ferramentas e também para barrar pesquisas científicas externas. Por exemplo, limitando o tipo de dados disponíveis para pesquisa, que muitas vezes incluem apenas informações sobre o comportamento do usuário, em vez do design ou operação das próprias plataformas. “Como pesquisadores independentes, avaliamos continuamente os riscos de as empresas entrarem com ações legais contra nós por atividades acadêmicas centrais: coleta e compartilhamento de dados, análise de descobertas, publicação de artigos e distribuição de resultados”, argumentam eles em seu comentário.

“Um grupo intergovernamental que representa os interesses dos Estados membros da ONU pode identificar quando os atuais níveis de transparência não geram informações suficientes”

Para exemplificar, eles destacam que, em 2021, a Meta, dona do Facebook, enviou um aviso de cessação a pesquisadores da Universidade de Nova York que haviam criado uma extensão de navegador para coletar dados sobre publicidade direcionada na plataforma. “A partir de conversas com colegas, sabemos que outros já foram desencorajados a fazer esse tipo de trabalho”, detalham.

Outro exemplo de como as redes sociais promovem conteúdo tóxico ocorreu quando o Facebook disponibilizou seus documentos para a Comissão de Valores Mobiliários dos Estados Unidos em 2021. Na ocasião, ficou claro que seu algoritmo classificava reações de emojis como cinco vezes mais valiosas do que curtidas ao longo de três anos. . Nesse período, dados internos mostraram que as postagens com o emoji de raiva tinham maior probabilidade de incluir conteúdo potencialmente nocivo e falso, como afirmações incorretas sobre vacinas.

Até agora, as tentativas de gerenciar ecossistemas de informação digital consistiram em colocar barreiras para proteger os dados do usuário, mas não mostraram como avaliar de forma confiável e prevenir danos. Ao contrário do problema da mudança climática, caracterizado por uma abundância de dados, com causas e consequências comparativamente bem compreendidas, e danos econômicos quantificáveis e evidentes a longo prazo, os riscos das tecnologias da informação ainda são um terreno pouco conhecido. Principalmente porque há falta de transparência por parte de quem os domina: “Um grupo intergovernamental que representa os interesses dos Estados membros da ONU poderia identificar quando os atuais níveis de transparência não geram informações suficientes”.

Um painel como esse, argumentam, teria credibilidade também em países não ocidentais, que consideram “cruciais”, pois as repercussões das tecnologias digitais atravessam fronteiras e se manifestam em diferentes contextos culturais. “Embora países como China, Rússia e Estados Unidos não concordem sobre como plataformas e serviços devem ser lançados ou limitados, as consequências do mundo digital transcendem as fronteiras internacionais. Qualquer esperança de negociação entre nações requer uma visão mais clara do que está acontecendo e por quê, e quais são as respostas políticas disponíveis.”

você pode seguir O PAÍS Tecnologia em Facebook y Twitter ou cadastre-se aqui para receber nossos newsletter semanal.

Com informações do EL Pais / Tecnología

Compartilhe este post